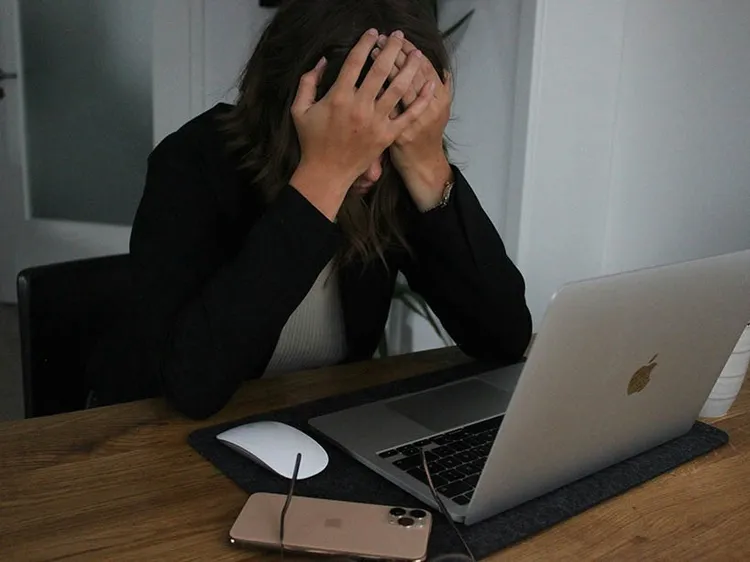

অনেক সময় কাউকে ফোন করা যায় না, কাউকে ইনবক্সে বলা যায় না, ‘আমি ভালো নেই।’ এ সময়েই অনেকেই মোবাইল বা ল্যাপটপে খুলে চ্যাটজিপিটির মতো এআই নিয়ে বসেন। আমার এক বন্ধুও আজকাল মন খারাপ হলে চ্যাটজিপিটির কাছে যায়। বন্ধুটির মনে হয় এআই যেন সত্যিই তাঁর উদ্বেগ বুঝতে পারছে।

এই এক অনুভূতি আজ হাজারো মানুষের। উদ্বেগ কমানো, শোক সামলানো, অফিসের টেনশন বা দাম্পত্য ঝগড়া—সবকিছু নিয়েই মানুষ এখন মনের কথা বলছে এআইয়ের সঙ্গে। ‘আমেরিকান সাইকোলজিক্যাল অ্যাসোসিয়েশন’-এর ২০২৫ সালের বৈশ্বিক জরিপ বলছে, ১৮ থেকে ৫৪ বছর বয়সী অনেকেই এখন মানসিক স্বাস্থ্য নিয়ে চ্যাটবটের সঙ্গে কথা বলতে বেশ স্বাচ্ছন্দ্যবোধ করেন।

কিন্তু প্রশ্ন হলো, এআই কি সত্যিই এমন জায়গা? এআইগুলো কি আদৌ থেরাপির জন্য তৈরি? চ্যাটজিপিটি থেকে জেমিনি—কোনোটিই থেরাপি করার উদ্দেশ্যে বানানো হয়নি। বাজারে থাকা রিপলিকা, উইসা, ইউপার বা মাইন্ডডক অ্যাপকেও বৈজ্ঞানিকভাবে অনুমোদিত ‘থেরাপি প্রোভাইডার’ বলা যায় না। বিশেষজ্ঞরা মনে করেন, এখনো এআই-চ্যাটবট থেরাপির জন্য বৈজ্ঞানিকভাবে স্বীকৃত নয়।

উদ্বেগ কমানো, শোক সামলানো, অফিসের টেনশন বা দাম্পত্য ঝগড়া, সবকিছু নিয়েই অনেক মানুষ এখন মনের কথা বলছে এআইয়ের সঙ্গে। সংগৃহীত ছবি

উদ্বেগ কমানো, শোক সামলানো, অফিসের টেনশন বা দাম্পত্য ঝগড়া, সবকিছু নিয়েই অনেক মানুষ এখন মনের কথা বলছে এআইয়ের সঙ্গে। সংগৃহীত ছবিঠিক এখানেই তৈরি হয় ঝুঁকি। এআই-এর ডেটায় পক্ষপাত থাকতে পারে। ফলে ব্যবহারকারী সম্পর্কে ভুল বা পক্ষপাতদুষ্ট ধারণা তৈরি হওয়ার সম্ভাবনা থাকে। আরও বড় বিষয় হলো, এআই মানুষের অনুভূতি বোঝে না। শুধু শব্দ দেখে হিসাব করে উত্তর দেয়। তাই গভীর আবেগ, দুঃখ ও শোকের সূক্ষ্মতা ধরতে পারে না।

আর এআই ব্যক্তিকে নয়, তথ্যকে দেখে। মানুষের কথা সে ‘ডেটা পয়েন্ট’ হিসেবে নেয়, ব্যক্তিগত সত্য হিসেবে নয়। ফলে অনেক সময় যন্ত্রের উত্তর মানুষের অবস্থার সঙ্গে মিলেই না। আবার তথ্য সুরক্ষার নিশ্চয়তাও নেই। অতীতে এআই-এর ভুল পরামর্শের কারণে আত্মহত্যার মতো ঘটনাও ঘটেছে। দায় কার ওপর? কেউ নেই।

একটি গবেষণা থেকে জানা যায়, অনেক চ্যাটবট আবার ‘সবসময় ইতিবাচক’ থাকার ভান করে। ব্যবহারকারী প্ল্যাটফর্ম না ছাড়ুক, সেটাই তাদের লক্ষ্য। ফলে মাঝে মাঝে ক্ষতিকর চিন্তাকেও তারা ভুলভাবে ‘ঠিক’ বলে সমর্থন করে বসে।

এখানে আরেকটি বড় ঝুঁকি হলো এআই-এর সঙ্গে অতিরিক্ত আবেগিক সম্পর্ক তৈরি হওয়া। বিশেষজ্ঞদের মতে, কেউ যদি ধীরে ধীরে চ্যাটবটকেই ‘সবচেয়ে কাছের মানুষ’ মনে করতে শুরু করেন, তাহলে বাস্তব জীবনের সম্পর্কগুলো ক্ষতিগ্রস্ত হতে পারে। বন্ধু–পরিবার থেকে দূরত্ব বাড়তে পারে। ফলে একাকিত্বও আরও গভীর হতে পারে। অন্যদিকে একজন থেরাপিস্ট রোগীর শরীরের ভাষা, ইতিহাস থেকে আচরণ, সব মিলিয়ে মানুষটিকে বোঝার চেষ্টা করেন। এআই সেটা পারে না। শুধু কথার ওপর ভিত্তি করে উত্তর দেয়।

এত ঝুঁকি সত্ত্বেও অনেক মানুষ চ্যাটবটের কাছে যায়। এর একটা বড় কারণ হলো সহজলভ্যতা। যুক্তরাষ্ট্রের কথাই ধরা যাক, থেরাপিস্ট পাওয়া গেলেও খরচ বেশি, সময় লাগে অনেক। স্ট্যানফোর্ডের গবেষকেরা বলছেন, যুক্তরাষ্ট্রে মানসিক স্বাস্থ্যসেবার প্রয়োজন থাকা প্রাপ্তবয়স্কদের অর্ধেক চিকিৎসাই পান না। কিশোরদের ক্ষেত্রে এই সংখ্যা আরও বেশি, প্রায় ৭৫%।

এই পরিস্থিতির মধ্যেও কিছু আশার আলো আছে। ডার্টমাউথ বিশ্ববিদ্যালয়ের গবেষকেরা ‘থেরাবট’ নামে একটি পরীক্ষামূলক এআই বানিয়েছেন, যা চার থেকে আট সপ্তাহে অনেকের উদ্বেগ ও বিষণ্নতা কমাতে পেরেছে। তবে গবেষণা এখনো প্রাথমিক পর্যায়ে আছে। দরকার আরও পরীক্ষা-নিরীক্ষা।

তথ্যসূত্র: ওয়েবএমডি